Inteligencia Artificial

El laboratorio de grandes lenguajes: IA como científico y sujeto

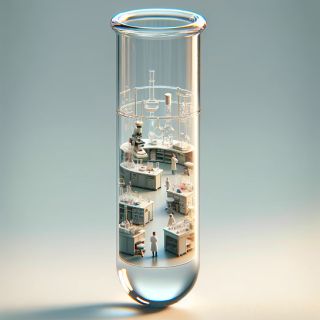

Los laboratorios virtuales son donde los humanos pueden ser simulados y estudiados.

26 de abril de 2024 Revisado por Davia Sills

Los puntos clave

- Un nuevo estudio utiliza LLM como científicos y sujetos para redefinir el papel de la IA en la ciencia.

- Las indicaciones efectivas son cruciales para extraer información de los LLM, con refinamiento iterativo.

- Los LLM sirven como laboratorios virtuales para una experimentación ética rápida en varios campos.

A medida que nos esforzamos más por utilizar y comprender la inteligencia artificial (IA), el potencial sin explotar de los modelos de lenguaje de gran tamaño (LLM por sus siglas en inglés) se está volviendo cada vez más evidente. Estos poderosos modelos, entrenados en vastos tesoros de datos, albergan en su interior una inmensa riqueza de conocimientos que se extiende mucho más allá de su capacidad para generar texto similar al humano. Sin embargo, gran parte de este conocimiento permanece inactivo, esperando ser desbloqueado y aprovechado para aplicaciones prácticas. Un nuevo artículo presenta un enfoque novedoso para extraer esta sabiduría latente, transformando a los LLM tanto en científicos como en sujetos mediante el uso de Modelos Causales Estructurales (SCMs por sus siglas en inglés) y técnicas de indicación cuidadosamente elaboradas.

La dualidad única de los LLM como científicos y sujetos

El artículo de Manning et al. introduce un cambio en la forma en que interactuamos y aprendemos de los LLM. Al integrar SCMs, una herramienta de análisis estadístico y aprendizaje automático, con LLMs, los investigadores crean laboratorios virtuales donde se pueden simular y estudiar interacciones humanas complejas y procesos de toma de decisiones en condiciones controladas. En este enfoque, los LLM asumen los roles tanto de científicos, diseñando y ejecutando experimentos, como de sujetos, participando en los escenarios simulados.

Este doble papel de los LLM abre nuevas vías para comprender las dinámicas ocultas y los sesgos que dan forma a los resultados del mundo real. Por ejemplo, el documento demuestra cómo un LLM puede simular una audiencia de fianza, con el modelo actuando como juez, acusado, abogado defensor y fiscal. Al variar sistemáticamente factores como el historial criminal del acusado, el número de casos del juez y el nivel de remordimiento del acusado, los investigadores descubren información sobre cómo estas variables influyen en el monto final de la fianza. Este enfoque no solo extrae conocimiento implícito de los datos de capacitación del LLM, sino que también arroja luz sobre la compleja interacción de factores que contribuyen a la toma de decisiones judiciales.

El poder de incitar

Si bien los SCMs proporcionan un marco estructurado para explorar el conocimiento latente dentro de los LLM, la efectividad de este enfoque depende del papel fundamental de la incitación. Las técnicas de solicitud implican elaborar cuidadosamente secuencias de entrada que guíen al LLM hacia tareas o resultados específicos. En el contexto del uso de LLM como científicos y sujetos, las indicaciones juegan un papel crucial para provocar los comportamientos deseados y extraer las ideas más relevantes.

Este estudio también destaca la importancia de diseñar indicaciones que sean específicas y abiertas, lo que le permita al LLM mostrar su conocimiento al tiempo que mantiene la flexibilidad para generar ideas novedosas. Por ejemplo, en el escenario de la audiencia de fianza, los investigadores usan indicaciones que le brindan al LLM el contexto y los roles necesarios, al tiempo que alientan al modelo a explorar los matices de las motivaciones y los procesos de toma de decisiones de cada personaje.

Además, el estudio enfatiza la naturaleza iterativa de la ingeniería rápida, donde los investigadores refinan continuamente sus indicaciones en función de las respuestas del LLM y las ideas obtenidas de cada simulación. Este proceso de ajuste fino de las indicaciones permite a los investigadores profundizar en el conocimiento latente del LLM, descubrir sesgos ocultos e identificar posibles intervenciones para mitigar su impacto.

Grandes laboratorios de lenguaje

El enfoque tiene implicaciones de gran alcance en varios dominios. En campos como las ciencias sociales, la economía y la psicología, esta metodología podría revolucionar la forma en que realizamos experimentos y probamos hipótesis. Al aprovechar los LLM como laboratorios virtuales, los investigadores pueden iterar rápidamente en diseños experimentales, explorar contrafactuales y descubrir ideas que podrían ser difíciles o poco éticas de obtener a través de la investigación tradicional con sujetos humanos.

Además, la capacidad de extraer y poner en funcionamiento el conocimiento latente dentro de las LLM tiene un potencial significativo para aplicaciones en el mundo real. Las empresas pueden utilizar estas técnicas para obtener información más profunda sobre el comportamiento del consumidor, optimizar los procesos de toma de decisiones y desarrollar soluciones impulsadas por IA más personalizadas y efectivas. Al descubrir y abordar los sesgos integrados en los LLM, también podemos trabajar para construir sistemas de IA que reflejen mejor la diversidad de las experiencias humanas.

El surgimiento del experimento "In-silico"

De cara al futuro, la investigación futura podría centrarse en ampliar la gama de escenarios y dominios en los que se puede aplicar este enfoque, refinar las técnicas de inducción para obtener conocimientos aún más matizados y desarrollar nuevas herramientas y marcos para agilizar la integración de SCMs y LLM. A medida que continuamos ampliando los límites de lo que es posible con la IA, la capacidad de aprovechar el conocimiento latente dentro de los LLM sin duda desempeñará un papel fundamental en la configuración del futuro de la tecnología y la sociedad.

Este estudio sirve como un llamado para que investigadores y profesionales reconozcan el potencial sin explotar dentro de las LLM y busquen activamente nuevas formas de extraer y utilizar este conocimiento latente. Al aprovechar el poder de los SCM y las técnicas de inducción, podemos transformar estos modelos de lenguaje en herramientas invaluables para el descubrimiento científico, la innovación empresarial y el progreso social. Las gemas ocultas dentro de los LLM esperan nuestro descubrimiento, y la clave para desbloquearlas radica en nuestra capacidad para hacer las preguntas correctas y diseñar las indicaciones correctas.

A version of this article originally appeared in English.